茱莉亚Busiek, 正规欧洲杯买球网站编辑部

Safiya Umoja Noble发誓她不是勒德分子. 但她确实认为我们都可以从 打机器的纺织工匠 在19世纪的英国,它的名字现在是技术怀疑主义的代名词.

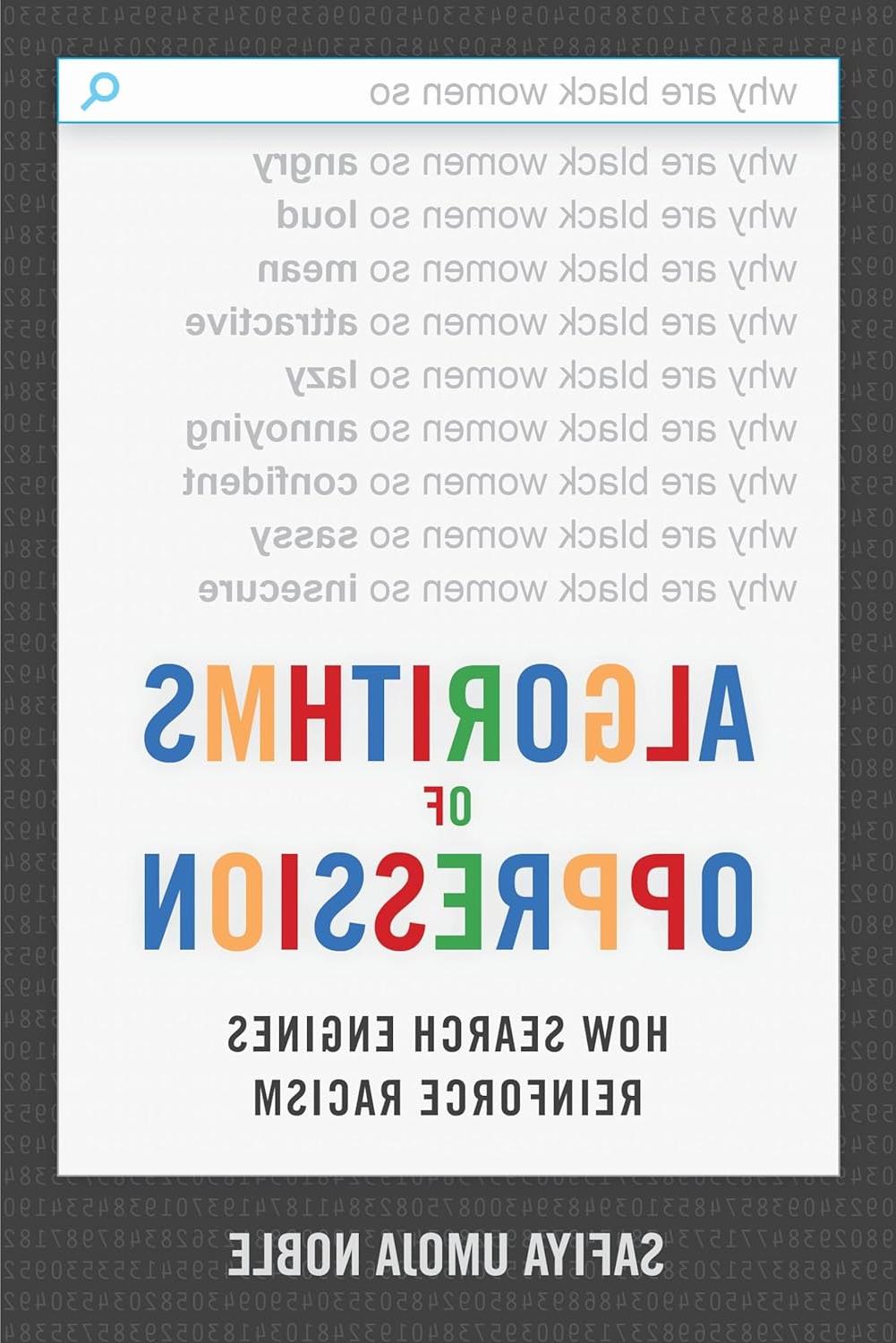

“卢德分子知道,这些新的工业化工具将改变我们的创造方式和工作方式,诺布尔说。, 正规欧洲杯买球网站洛杉矶分校性别研究和非裔美国人研究教授. 诺布尔的奖学金研究了正在改变我们工作方式的新工具:她2018年的书, 《压迫算法:搜索引擎如何强化种族主义,”他说。 国家对话 关于互联网搜索引擎中的算法歧视,并为她赢得了a 麦克阿瑟“天才”奖学金. 在2月份, 诺布尔在正规欧洲杯买球网站洛杉矶分校执行副校长达内尔·亨特的主题对话中讨论了她的工作 人工智能学术大会.

作为对诺布尔和其他人工作的回应, 科技公司已经解决了一些最明显的搜索引擎问题. 但是,控制谷歌搜索结果的算法只是人工智能正在塑造我们生活和生计的众多方式之一, 来宝公司表示,无论是企业自我监管还是政府监管,都跟不上这项技术的发展和潜在危害.

最近,我们采访了诺布尔,进一步了解了互联网为何如此运作, 以及这对人工智能驱动的未来意味着什么.

你为什么要写《压迫的算法》?你的作品带来了什么影响?

这本书探索了当你向搜索引擎询问社会问题时会发生什么, 尤其是弱势群体. 当我在谷歌上搜索黑人女孩时, 亚洲女孩, 拉丁女孩, 80%的搜索结果的第一页是色情或过度性感的内容. 而且我不需要输入“性”或“色情”这两个词.“黑人女孩和妇女已经是色情作品的代名词.

“压迫的算法”开始描述这里发生的事情. 我认为这项工作的突破, 这是常识吗, 算法会有区别吗. 现在,普通用户都明白了这一点. “算法”是我们词汇的一部分.

在学术方面, 现在我们在全国各地有成千上万的研究人员,在世界各地可能有成千上万的研究人员在研究科技的危害. 我的工作主要是在工业领域. 我以为硅谷会对它怀有敌意, 但我认为它为他们所经历的事情提供了语言.

搜索引擎结果在哪些方面影响了人们的生活?

当你的身份在历史上受到压迫时, 你以不同的方式体验系统. 有些人仍然只是为了lol而分享猫, 而其他人则因种族主义内容而受到彻底的创伤.

如果这个国家所有的黑人妇女和女孩把我们所有的钱放在一起, 我们仍然不会像色情产业那样赚钱. 我们将永远无法控制我们的关键字优化的方式. 那么我们将如何干预这些系统呢?

谷歌和其他公司首先表示,他们知道这些问题的存在,并正在努力解决它们. 但我看不出他们真的有能力处理他们体制中的权力和不平等. 如果有什么区别的话, 他们只是在调整这些算法,而不是以深刻的方式重塑它们.

如果搜索结果不是中立的,为什么我们会得到我们想要的结果呢?

十年前流行的逻辑是,任何出现在搜索引擎上的东西都只是我们自己的反映. 完全没有意识到, 在基本层面上, 这些平台的编码方式以及它们如何优先考虑某些类型的值.

首先, 有一种算法正在筛选数百万可能出现在第一页的潜在网站. 然后你看到的结果受到行业的影响, 外国特工和政治运动通过灰色市场的搜索引擎优化. 这是一个完整的家庭手工业,它的存在是为了弄清楚如何操纵搜索引擎.

拥有搜索引擎的公司会对出价最高的公司做出回应. 是的,他们一直在努力改进和检测他们的系统在哪里被欺骗. 但他们已经制造出了可以被玩弄的产品. 所以那些制造容易操纵的产品的公司是有责任的.

你的研究如何改变了你使用互联网的方式?

我对搜索有很多怀疑. 我不像去图书馆那样使用它. 我用它来购物,这可能是它最适合的设计.

对于像电视或电影这样的东西,我们知道有一个主观的观点. 如果在其他媒体上有种族主义或性别歧视的错误陈述, 我们理解导演或编剧的观点.

但我们不认为搜索结果是主观的. 我们把搜索引擎当成事实核查员. 对于某些事实,它们是非常可靠的:数学家可以输入一个公式,看看代码中哪里有错误. 或者你也可以用它来表达一些老生常谈的事情,比如“最近的咖啡店在哪里??“你会得到一个非常可靠的答案.

所以如果它在无意义的事情上是可靠的, 这就强化了你的信念,那就是它对每件事都有意义. 但如果你用同样的工具来回答一个社会或政治问题, 你认为你会得到一个可靠的答案吗?

如果你不使用谷歌和其他搜索引擎搜索社会或政治信息, 你会怎么做呢?

我们有这些东西叫做图书馆! 想想在某样东西出现在图书馆之前会发生什么:有编辑, 评论家, 一个出版商. 还有图书管理员, 谁非常认真地对待他们对公众和保存知识的义务. 他们接受的训练是对知识进行分类,使公众能够理解他们所从事的工作.

如果你想在图书馆找一本关于大屠杀的书, 你会发现它与许多其他关于大屠杀的作品有关. 当你把它从架子上拿下来的时候, 你可以发现它周围的其他东西:它在历史上吗, 或者时事, 或社会学?

如果你用搜索引擎, 你可能会看到一个否认大屠杀的网站,看起来像是合法的信息, 你可能很难分辨它是什么,因为它完全脱离了语境. 它不像包装上写着,“这是互联网上白人至上主义的部分!”

输入:ChatGPT. 关于生成式人工智能如何再现或抵消你在搜索中发现的各种歧视,你看到了什么, 为什么?

ChatGPT是一种基于我们所说的大型语言模型的人工智能. 这些模型基本上吸收了互联网上所有可用的数据到它们的训练数据中, 哪一个, 原因我们已经讨论过了, 并不总是一个好主意. 他们接受版权作品和学术奖学金, 就像, 随机subreddits, 好像这些东西都一样可靠似的.

生产生成式人工智能的公司发布的产品还没有准备好进入黄金时段. 现在,我们每周都会在新闻中看到关于生成人工智能工具及其问题的报道. 比如,很多大型语言模型产生的结果都是不正确的. 最近还有一个生成式人工智能艺术工具 拒绝呈现黑人医生治疗白人病人的画面.

我的意思是,这些大型语言模型没有代理,所以它们实际上不能拒绝. 它们只是统计模式匹配工具. 但是缺乏多种性别表达的可能性, 多种类型的种族和民族代表——我们在社会中受到这些东西的限制, 我们在训练模型的数据上甚至更加有限. 所以这些模型在产生某些类型的结果方面是有限的.

你在做些什么来让你的学生们准备好驾驭一个由人工智能塑造的世界?

十多年来,我一直在用谷歌搜索教我的学生媒体素养. 我会让学生搜索对他们来说很重要的身份,然后把结果带回来,我们就这个问题进行讨论. 所以我会让学生搜索, 说, “妇女联谊会女孩,你可以想象他们对结果的反应, 就像, “这是完全不对的.“结果往往是如此深刻的种族主义或性别歧视, 或者在某些方面,学生们对自己的看法是错误的.

在某些方面, ChatGPT只是搜索的下一个版本, 因为它没有区分宣传和证据. 学生们来到我的课堂,用宣传网站作为证据, 因为他们分不清其中的区别. 所以能够在课堂上进行这些对话是很重要的. 但我更希望在政策层面看到更多的干预. 现在,它就像,好吧,人工智能在这里,就是这样. 你们,公众,必须学会如何使用它,你必须智取它,你必须弄清楚它. 当我们可以对这些工具进行不同的监管,并将它们的采用限制在有意义的地方时,这似乎是可悲的不足.

比起把所有的创造和决策都交给人类,我们有理由乐观地认为,更好的算法能更快地减少社会偏见吗, 我们的内隐偏见, 永远?

开发预测人工智能模型的人认为,他们正在减少人类的偏见. 但是没有哪一种情况是你没有优先级的, 决策树, 一种重视某物高于其他物的体系. 所以说我们努力消除技术偏见是不恰当的, 就像我们不想消除人们的偏见一样. 我们要做的是非常具体:我们要减少各种形式的歧视和不公平, 这和消除偏见是不一样的.

你也可以这样描述:我们持有一定的价值. 我们要确保这些价值得到满足. 因此,这意味着我们必须承认,这项技术确实是一套特定的价值观,或者是围绕一套价值观编程的. 我们想优化得到更多我们想要的值.

我们试着对人这样做. 这就是为什么我们要接受教育. 这就是我们了解他人的原因. 这就是为什么我们从事艺术和那些让我们对人性的广度敏感的事情.

说你想要一种完全中立的技术,没有任何区分人的标记, 你只是默认了由你自己的偏见驱动的优先级. 如果我们想要朝着多元化和亲民主的方向努力, 我们必须为我们看重的东西制定计划.

我们所知道的支配科技的价值观是什么?

十年前, 如果搜索公司优先考虑, 假设, 妇女和女童的福祉, 他们不会让色情行业成为他们社会中出价最高的行业. 这是不可能发生的. 他们以牺牲妇女利益为代价来追求利润.

我们不再处于一个色情主宰搜索的时代,因为这些公司不得不对许多批评做出回应. 但硅谷领导人的意识形态世界观仍然令人不安. 他们认为技术官僚可以设计出一个更好的社会,而民主制度太混乱了. 这些政治因素渗透在他们生产的产品中, 它们指向谁, 谁做过实验,谁在世界上被认为是一次性的.

我有机会考虑在其他地方做这种工作. 但我的心还是在正规欧洲杯买球网站,因为公共机构是与私营部门抗衡的强大力量. 我们代表公众做研究是非常重要的, 加州人民和这个国家, 因为我们希望不会像在工业领域工作的人那样受到各种压力的影响.

我们可以从过去的社会变革中吸取哪些与人工智能共存的经验教训呢?

我告诉我的本科生,“当我妈妈生我的时候,她嘴里叼着一支烟. 医生也这么做了.“他们吓坏了! 他们说,“不可能发生这种事!我说:“这绝对是真的。.”

我小的时候,我们经常看杂志,看到这样的广告, “四分之三的医生更喜欢骆驼牌香烟.“在每一部电影、每一部电视节目中,要想变得迷人,就得吸烟. 烟草业塑造了我们的现实感. 这是如此的正常,以至于我仍然感到惊讶,我没有看到任何人吸烟了. 那是因为我们控制了吸烟.

今天长大的人甚至无法想象以前的时代. 所以我想我们可能会回顾这个时代说, 我为什么不直接问我妈这个问题,而是去谷歌? 我为什么不读一本书呢? 我们是怎么走到这一步的?